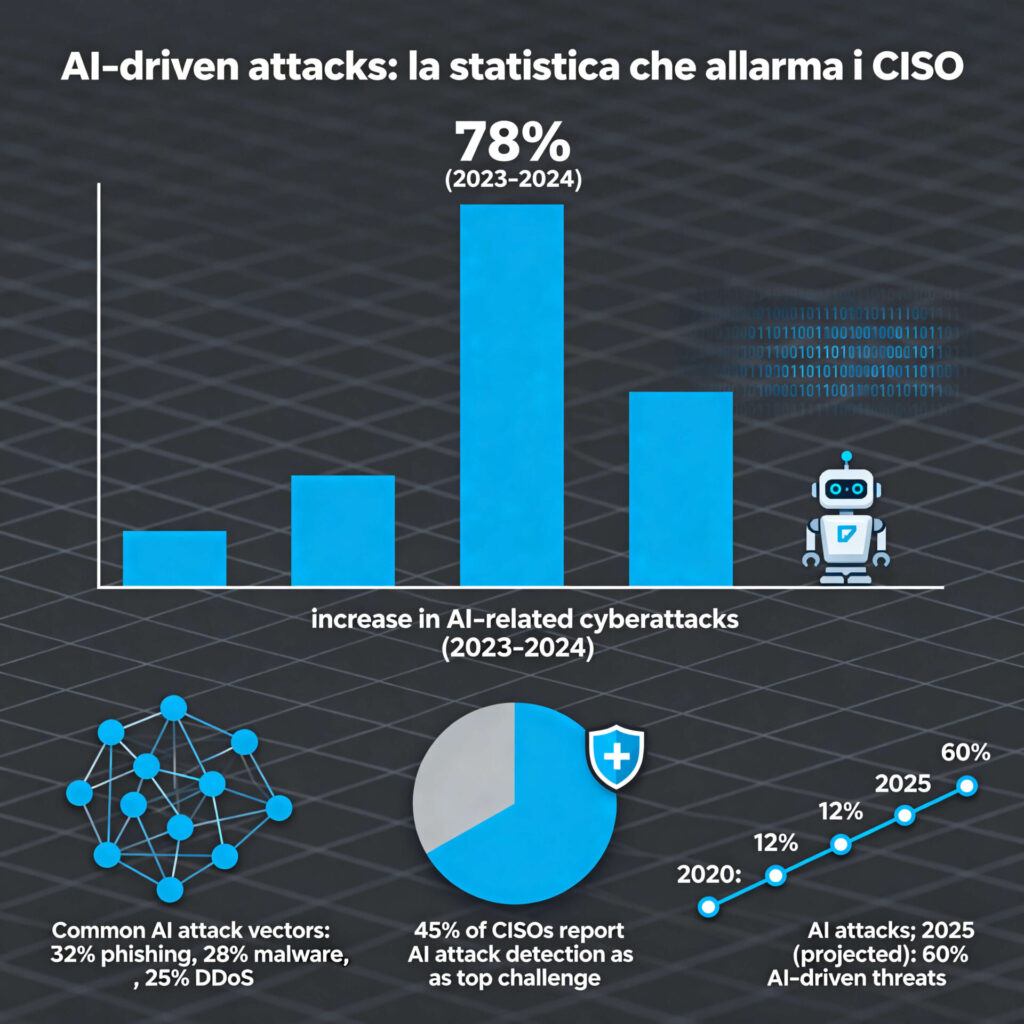

Negli ultimi due anni la cybersecurity ha subito una trasformazione radicale: non è più soltanto un gioco di difesa contro attaccanti umani, ma una corsa contro sistemi automatizzati, adattivi e sempre più intelligenti. L’avvento dell’AI generativa ha aperto un nuovo fronte, e una statistica in particolare sta facendo tremare i CISO di mezzo mondo: oltre il 60% degli attacchi informatici nel 2024 ha utilizzato, in almeno una fase della kill chain, strumenti di intelligenza artificiale.

Per chi vive la sicurezza sul campo, questa non è una sorpresa. Per chi deve prendere decisioni strategiche — budget, risk management, compliance — è un campanello d’allarme che non può essere ignorato.

In questo articolo analizziamo perché questa statistica è così rilevante, come stanno cambiando le tecniche offensive e quali contromisure concrete possono adottare le aziende.

Perché questa statistica è così pericolosa

L’AI non è solo un acceleratore: è un moltiplicatore di capacità. Un attaccante con competenze limitate può improvvisamente:

- generare phishing perfetti in qualsiasi lingua

- automatizzare ricognizioni OSINT su larga scala

- creare malware polimorfico che muta a ogni esecuzione

- sfruttare modelli per individuare vulnerabilità in codice e infrastrutture

- orchestrare attacchi complessi con costi quasi nulli

Il risultato è un ecosistema di minacce dove la barriera d’ingresso è crollata, mentre la velocità e la precisione degli attacchi sono aumentate.

Per un CISO, questo significa una sola cosa: il modello di rischio tradizionale non è più sufficiente.

Come l’AI sta cambiando la kill chain

L’AI non sostituisce l’attaccante umano, ma lo potenzia. Ecco come interviene nelle varie fasi.

1. Reconnaissance automatizzata

Modelli di AI analizzano:

- social network dei dipendenti

- repository GitHub

- documenti PDF pubblici

- metadati esposti

- configurazioni cloud mal gestite

Il tutto in pochi minuti. Dove prima servivano ore di OSINT manuale, ora bastano script che orchestrano modelli linguistici e tool di scraping.

2. Social engineering iper-personalizzato

Il phishing non è più “generico”: è mirato, contestuale, credibile.

Esempio reale: email che imitano perfettamente il tono di un dirigente, con riferimenti a progetti interni estratti da documenti pubblici. L’AI genera varianti infinite, rendendo inefficaci i filtri basati su pattern.

3. Sfruttamento delle vulnerabilità

L’AI accelera:

- analisi del codice

- fuzzing intelligente

- generazione di exploit proof-of-concept

Non serve più essere un exploit developer esperto: basta saper orchestrare i modelli giusti.

4. Malware adattivo

Il malware AI-driven:

- muta automaticamente per evitare le firme

- analizza l’ambiente e sceglie il payload più efficace

- utilizza modelli per evitare sandbox e honeypot

È un salto evolutivo paragonabile al passaggio dai virus statici ai worm autoriproducenti.

5. Automazione del movimento laterale

L’AI può:

- mappare la rete

- identificare i target più deboli

- scegliere la strategia di escalation più efficace

Il tutto con un livello di autonomia che ricorda gli APT, ma con costi da script kiddie.

Perché i CISO sono preoccupati

La statistica del 60% non è solo un numero: è un indicatore di un trend irreversibile.

Aumento del volume degli attacchi

L’AI permette di scalare gli attacchi come se fossero campagne di marketing: massivi, automatizzati, continui.

Riduzione del tempo di rilevamento

Gli attacchi sono più veloci, più puliti, più difficili da distinguere dal traffico legittimo.

Skill gap interno

Le aziende non hanno abbastanza personale con competenze AI-cybersecurity. Gli attaccanti sì.

Tool difensivi non ancora maturi

Molti strumenti di difesa basati su AI sono ancora in fase di consolidamento. Gli attaccanti, invece, sperimentano senza vincoli.

Impatto sulla supply chain

L’AI amplifica gli attacchi indiretti: un singolo fornitore compromesso può generare un effetto domino devastante.

Come rispondere: le contromisure che funzionano davvero

Non esiste una soluzione magica, ma esistono strategie efficaci.

AI per difendersi dall’AI

È inevitabile: serve adottare strumenti di difesa basati su modelli avanzati.

- anomaly detection comportamentale

- analisi predittiva delle minacce

- sistemi di risposta automatizzata

- modelli per identificare phishing generato da AI

La difesa deve essere altrettanto veloce e adattiva dell’attacco.

Zero Trust come fondamento

Non è più un’opzione. È l’unico modello che riduce l’impatto del movimento laterale automatizzato.

Hardening continuo e automatizzato

L’AI può aiutare anche qui:

- scansioni di configurazioni cloud

- analisi del codice

- patching prioritizzato

Formazione avanzata per i team

Non basta il corso annuale di cybersecurity. Serve:

- training su attacchi AI-driven

- simulazioni realistiche

- red team potenziati da AI

Governance e policy aggiornate

Molte aziende non hanno ancora policy che considerino:

- uso interno dell’AI

- rischi di data leakage

- modelli shadow AI creati dai dipendenti

La governance deve evolvere tanto quanto la tecnologia.

Il futuro: attacchi autonomi e difese adattive

La prossima frontiera è chiara: attacchi completamente autonomi, capaci di prendere decisioni tattiche senza intervento umano. Non siamo ancora a quel punto, ma la traiettoria è evidente.

Parallelamente, vedremo:

- SOC aumentati da AI

- threat intelligence predittiva

- modelli specializzati per settori critici

- framework di sicurezza “self-healing”

Il ruolo del CISO diventerà sempre più strategico: non solo difendere, ma anticipare.

Ulteriori informazioni:

La statistica che indica che oltre il 60% degli attacchi moderni sfrutta l’AI non è un dato isolato: è il segnale di un cambiamento epocale. L’AI ha democratizzato il cybercrime, aumentato la complessità delle minacce e ridotto i tempi di reazione.

Per i CISO, la sfida non è solo tecnica: è culturale, organizzativa, strategica.

Chi saprà integrare l’AI nella propria difesa, aggiornare la governance e formare i team avrà un vantaggio competitivo enorme. Chi resterà ancorato ai modelli tradizionali rischia di essere travolto.